“随着5G通信、人工智能、万物互联等新一轮技术革命和产业变革的加速演进,网络安全形势也会越来越严峻。”全国政协委员、360集团董事长兼首席执行官周鸿祎日前接受新华每日电讯记者专访时表示,要站在坚持总体国家安全观的全局高度,打破各自为战的传统网络安全模式,统一安全大数据,共建国家级网络安全大脑,构筑大安全时代的国家网络空间安全防线。

共建网络安全大脑,践行总体国家安全观

记者:今年全国两会期间,您向大会提交了“统一安全大数据,共建国家级网络安全大脑”的提案,请问其中主要问题和建议是什么?360安全大脑为何选择汽车行业应用作为突破口?

周鸿祎:毋庸置疑,未来数以百亿计的智能设备,必将深入我们生产生活的方方面面。随着“一切皆可编程,万物均要互联”的大安全时代到来,网络安全风险也从虚拟空间扩展到物理世界,从过去相对孤立的数据泄露、病毒和木马等侵袭,转向对国家安全、国防安全、关键基础设施安全、社会安全乃至人身安全的恶意控制或攻击,网络安全形势越发严峻。

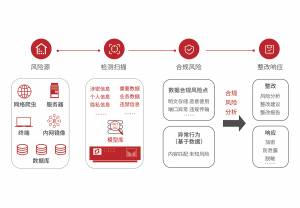

虽然我们也建立了一些网络安全防御系统,但数据孤岛、各自为战等现象普遍存在。无论是企业、网络安全公司、运营商还是政府部门,都分兵把口各自掌握一部分数据,既看不到全局,也形不成合力。

因此,要站在坚持总体国家安全观的全局高度,统一安全大数据,共建国家级网络安全大脑,利用基于大数据的人工智能,解决万物互联时代错综复杂的安全问题,构筑大安全时代的国家网络空间安全防线。

首先,建议将国家级网络安全大脑列为国家重大工程专项,成立国家网络安全大脑项目总体工作组、专家组、工程推进组,分别负责顶层设计和总体筹划、系统设计、工程建设。

其次,建议由国家相关部门牵头,协调网信、工信、公安、科技等部门和单位,组织国企、民企、科研院所等广泛参与,发挥新型举国体制优势。

360汽车安全大脑是我们针对汽车行业的解决方案,是360安全大脑的一部分。我们选择汽车行业作为重点关注领域,主要基于车联网技术的快速发展与应用,为网络安全技术研究提供了丰富的案例,以及多样化的研究环境。

同时,智能汽车作为交通工具,一旦被黑客攻击或劫持,有可能造成人身伤害、群死群伤等安全事故,威胁人身安全、社会安全和国家安全。

目前,我们是全球车联网领域唯一能提供整套智能汽车安全产品方案的企业,已连接到360汽车安全大脑的智能汽车超过15万辆,我们争取2020年实现100万辆。

从“颠覆者”到“赋能者”,重构网络安全生态观

记者:面向5G时代和产业互联网,360提出要从行业“颠覆者”变身生态“赋能者”,这种新型网络安全行业生态观是如何形成的?免费杀毒的模式是否会导入产业互联网中?

周鸿祎:5G通信是新一代的移动通信,带宽大幅度增强,峰值速率是4G的100倍。从网络安全方面来看,最大的挑战在于它构筑了万物互联的基础,海量IOT设备的普及和数据的传输成为可能。

围绕5G技术落地商用,由AR、VR以及AI等交互技术所衍生发展的新业务、新架构、新技术,都对整体网络安全提出了新的挑战,已远非政府、企业、个人可以局部应对的,这就需要利用新技术打造一个整体的解决方案。

去年,我们基于安全大数据构建了360安全大脑,可以实现网络安全的自动化、智能化。360希望开放自己的技术、人才、数据、知识,变成很多安全公司背后一个技术和数据的赋能者,共同把安全生态做起来。未来360只有朋友没有对手。

从颠覆到赋能,其实是互联网上下半场的区别。其实,互联网在早期创新的时候,更多的是一种商业模式和用户体验的创新,所以看到一些互联网公司上半场颠覆了很多行业。但是轮到下半场也就是产业互联网,面临的已不是谁干掉谁的问题,而是如何融合发展的问题。

很多传统产业特别像制造业有非常深的底蕴,他们需要互联网、云计算、大数据、人工智能、区块链、物联网、网络安全这些技术来改造升级。在这个过程中,你很难找到一家公司,又精通互联网,又精通传统行业,这里需要这几个行业进行深度融合,而不是相互替代。产业互联网时代的主角将是以传统企业为主的实体经济,互联网公司更多的是提供赋能。

相形之下,免费杀毒模式是基于软件系统,而产业互联网的终端更多是硬件产品,无法像软件一样小步快跑、快速迭代,硬件产品的成本、技术、用户体验、供应链管理都更加复杂。

“安全应成为人工智能发展的基础和前提”

记者:信息世界与物理世界联通,使安全问题总是变得错综复杂,而人工智能的安全隐患则更令人担忧。您能否举例说明“安全应成为人工智能发展的基础与前提”的论断?

周鸿祎:往往任何技术的发展都有两面性。人工智能无疑是下一轮技术革命的焦点,但目前的人工智能自身就存在安全问题——

首先,前端传感器被干扰。无人驾驶汽车识别路况信息,主要依靠红外感应、激光雷达等各类车载传感器,而这些传感器目前并不安全,很容易被干扰,造成人工智能识别和决策失误。比如我们用激光笔干扰车载雷达,就有可能造成车辆急停,引起追尾事故。

其次,训练数据被污染。人工智能是大数据训练出来的,训练的数据可以被污染,甚至被黑客进行“数据投毒”。此前微软聊天机器人Tay,因未对Tay与网友的对话做任何设定,上线16个小时内就被“教坏”,成为一名满口暴力的“不良少年”,甚至不乏偏激的种族主义言论,最后不得不匆匆下线。

还有,内部算法不完善。作为一种概率判断系统,即使人工智能可以保证99.99%的准确性,但是对于安全来讲,它只要出现一次错误,就会造成严重后果。2018年,美国Uber公司自动驾驶测试车发生了撞人事故。当时这辆汽车处于光线很暗的环境中,被撞的女士穿了件黑色衣服,人工智能系统没有做出任何判断,甚至没有减速,最终酿成了悲剧。

另外,实现平台有漏洞。许多AI系统都依赖开源的深度学习软件,经验表明,软件只要是人写的就一定有漏洞,有漏洞就会被人利用。我们的研究人员已经发现了40多个深度学习框架的软件漏洞。另外,随着开源算法越来越通用,潜在的风险也会增多。

目前,随着人工智能与人类生活的深度融合,人们在享受这些新技术带来的便利时,往往容易忽视技术自身的安全问题。我们已经看到,针对物联网、智能家居、无人驾驶汽车等智能系统的攻击在不断出现,人工智能用于网络攻击、网络犯罪的事件也屡有发生。因此,安全应成为人工智能发展的基础与前提,以确保人工智能健康有序发展。