1月20日消息,据外媒报道,谷歌及其母公司Alphabet首席执行官桑达尔·皮查伊(Sundar Pichai)日前亲自撰文,声称人工智能(AI)太过重要,必须受到监管,人们非常担心AI造成的潜在负面后果。公司不能仅仅建立新技术,而放任市场力量来决定如何使用它。

皮查伊撰文全文如下:

我在印度长大,总是对技术痴迷不已。每项新发明都以意义非凡的方式改变了我和家人的生活。有了电话,我们就不必长途跋涉去医院看检查结果了。冰箱意味着我们可以花更少的时间做饭,电视让我们可以在收听短波收音机的同时看到我们只能想象的世界新闻和板球比赛。

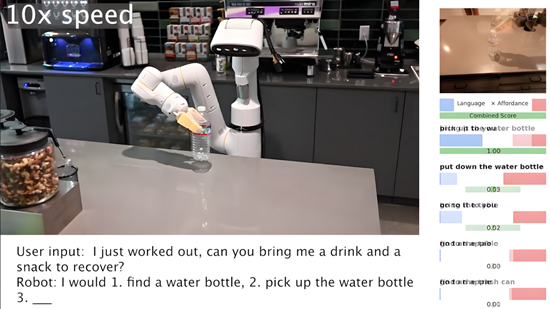

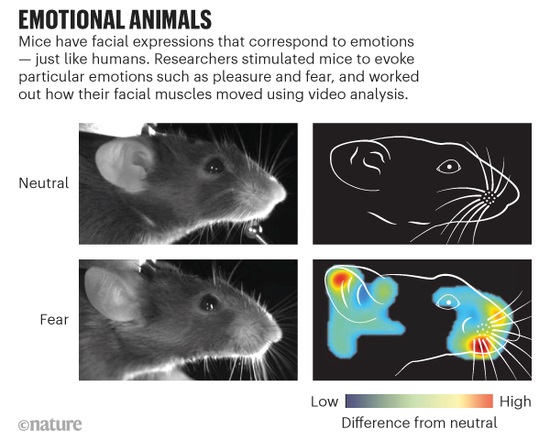

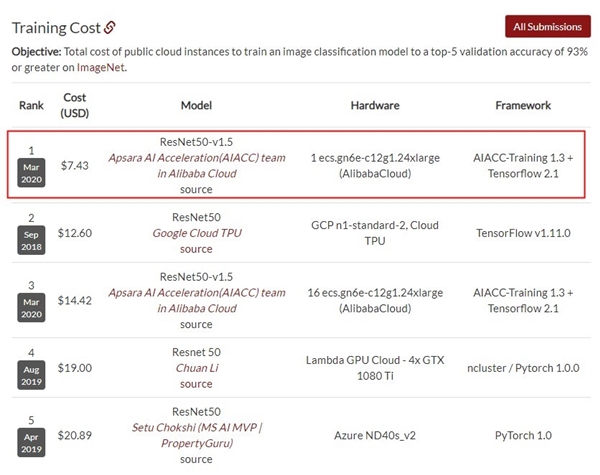

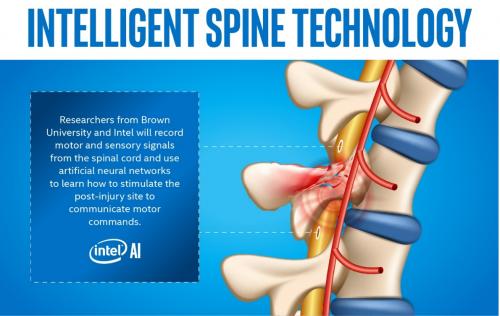

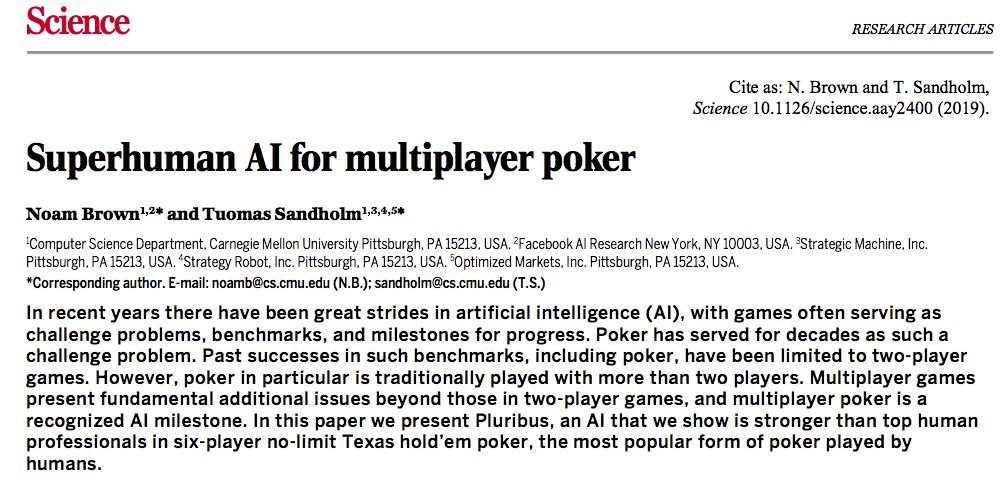

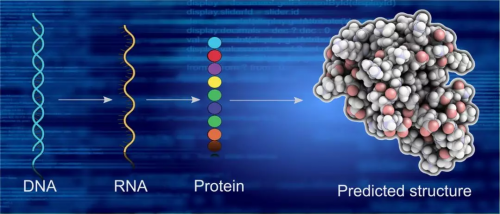

现在,我很荣幸能帮助塑造新的技术,我们希望这些技术将改变世界各地人们的生活。其中,最有前途的技术包括AI:就在本月,关于Alphabet和谷歌如何挖掘AI潜力的三个具体例证已经发布。《自然》发表了我们的研究,显示AI模型可以帮助医生在乳房X光检查中更准确地发现乳腺癌;作为应对气候变化的重要组成部分,我们正在使用AI更快、更准确地对降雨量做出即时的预测;汉莎航空集团正在与我们的云计算部门合作,测试使用AI来帮助减少航班延误。

然而,历史上有很多例子表明,技术的发展也会带来出人意料的负面影响。内燃机让人们可以长途旅行,但也造成了更多的事故。互联网使人们有可能与任何人联系,从任何地方获取信息,但也更容易传播错误信息。这些教训告诉我们,我们需要清醒地认识到可能会出现的问题。

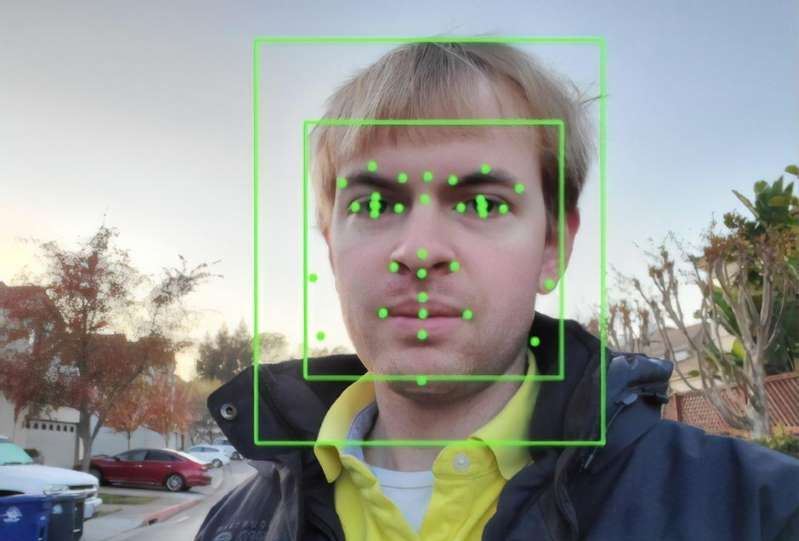

人们确实担心AI造成的潜在负面后果,从深度换脸(deepfakes)到抑制面部识别技术的使用。虽然许多公司已经做了很多工作来解决这些担忧,但未来不可避免地会有更多挑战,没有任何单独的公司或行业可以单独应对。欧盟和美国已经开始制定监管提案,国际协调将是使全球标准发挥作用的关键。

要实现这个目标,我们需要在核心价值观方面达成一致。像我们这样的公司不能仅仅创造有前途的新技术,然后让市场力量决定如何使用它。我们同样有责任确保科技得到善用,让每个人都可以使用。现在,在我看来,AI需要受到监管,这是毋庸置疑的。这项技术太过重要,不能放任不管。

唯一的问题是如何对待它。这就是为何谷歌在2018年发布了自己的AI原则的理由,旨在帮助指导这项技术以符合伦理道德的方式开发和使用。这些指导方针帮助我们避免偏见,严格测试安全性,在设计之初就将隐私放在首位,并使技术对人们负责。这些原则还指定了我们不会设计或部署AI的领域,例如支持大规模监视或侵犯人权。

但停留在纸面上的原则没有任何实际意义。因此,我们还开发了将其付诸实施的工具,例如测试AI决策的公平性,以及对新产品进行独立的人权评估。我们甚至走得更远,让这些工具和相关的开源代码广泛可用,这将使其他人能够善意地使用AI。我们认为,任何开发新AI工具的公司都应该遵循这些指导原则和严格的审查程序,政府的监管也需要发挥重要作用。

我们不必从头开始去做。现有的规则可以作为坚实的基础,如欧洲的《通用数据保护条例》。好的监管框架将考虑安全性、可解释性、公平性和问责性,以确保我们以正确的方式开发正确的工具。明智的监管还必须采取相称的方法,平衡潜在的危害,特别是在高风险领域。监管可以提供广泛的指导,同时允许在不同部门有针对性地部署技术。

对于有些AI技术的使用,例如包括AI辅助心脏监测器在内的受监管医疗设备,现有框架提供了很好的监管基础。对于自动驾驶汽车等较新的领域,政府将需要建立适当的新规则,并考虑所有相关的成本和好处。谷歌的作用始于认识到,应用AI需要遵循原则性的、受监管的方法,但它并没有到此为止。

我们希望在监管机构努力应对不可避免的紧张局势和权衡取舍时,成为他们的合作伙伴。在共同应对这些问题时,我们可以提供我们的专业知识、经验和工具。AI有可能改善数十亿人的生活,而最大的风险可能是无法实现这个目标。通过确保以负责任的方式构建AI,使每个人都受益,我们可以激励子孙后代像我一样相信技术的变革力量。