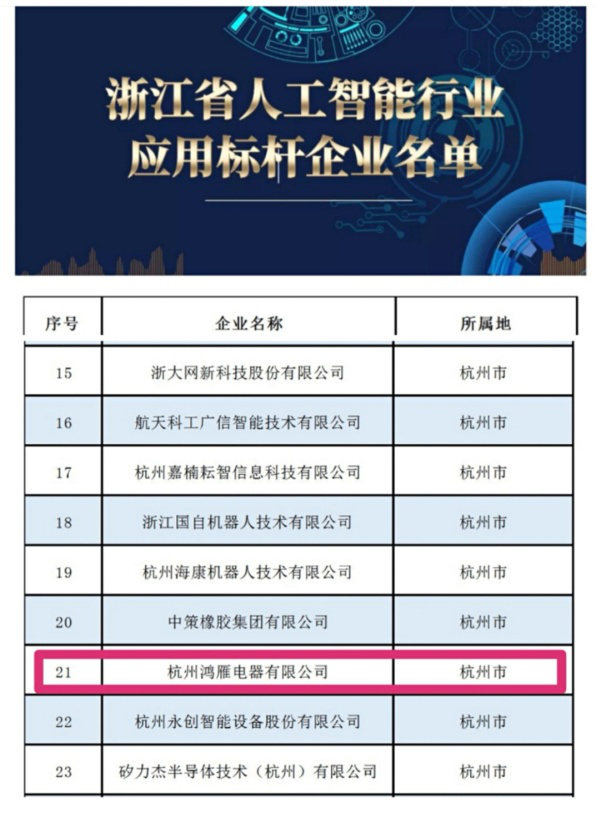

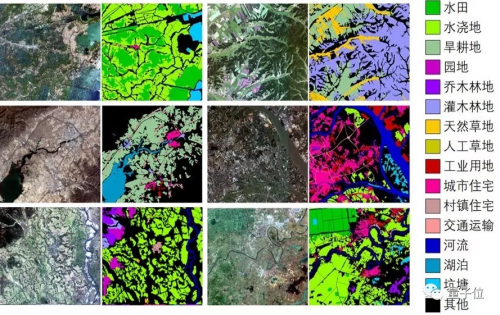

一物理学理念正帮助计算机学习在比二维更高的维度中进行“观察”。新的人工智能技术不仅能够在二维图像中发现模式,还能够在球体和其他曲面上发现模式,从而将人工智能从“平面世界”中跳脱出来。

以下是翻译内容

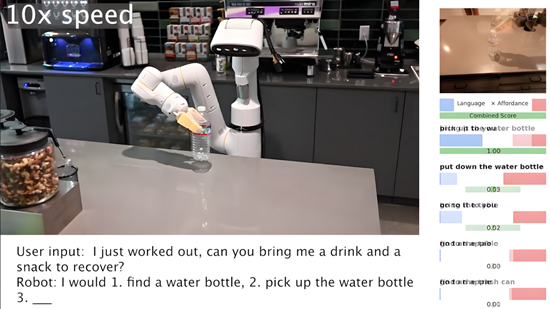

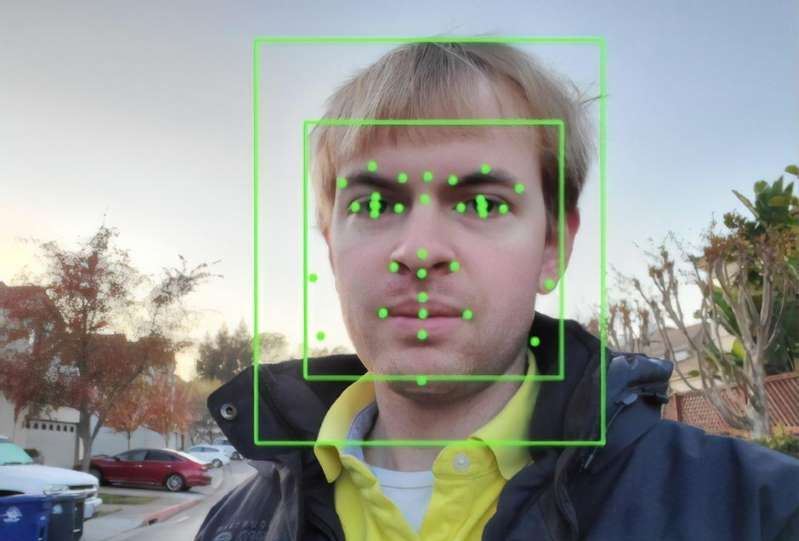

计算机现在能够开车,能够在国际象棋和围棋等棋类游戏中击败人类世界冠军,甚至能够创作散文。人工智能的革命在很大程度上源于一种特殊的人工神经网络,它的设计灵感来自于哺乳动物视觉皮层中相互连接的神经元层。令人惊讶的是,这些“卷积神经网络”已被证明能够熟练地学习二维数据中的模式——尤其是在识别数字图像中的手写文字和物体等计算机视觉任务中。

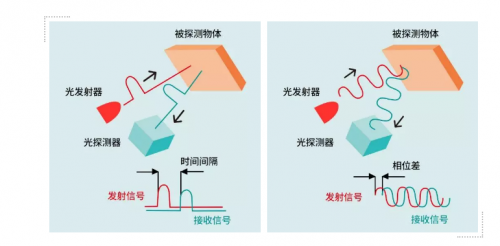

但是,当应用到没有内置平面几何的数据集时——例如,三维计算机动画中使用的不规则形状模型,或者自动驾驶汽车生成的、用来绘制周围环境的点云——这种强大的机器学习架构就不奏效。2016年,一门名为几何深度学习的新学科应运而生,其目标是将卷积神经网络从二维世界中跳脱出来。

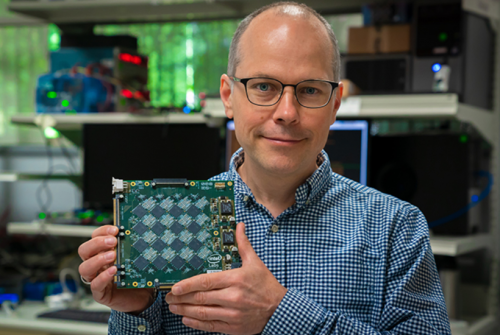

现在,研究人员提出了一种新的理论框架,用于构建能够在任何几何表面上学习模式的神经网络。这些网络名为“规范等变神经网络”,由塔科·科恩(Taco Cohen)、莫里斯·韦勒(Maurice Weiler)、贝尔卡伊·基卡纳格鲁(Berkay Kicanaoglu)和马克斯·韦林(Max Welling)在阿姆斯特丹大学和高通人工智能研究机构共同开发而成。它们不仅可以发现二维像素阵列的模式,还可以发现球体和非对称曲面物体上的模式。“这个框架是对曲面深度学习问题的一个明确解答。”韦林说道。

在从模拟全球气候数据中学习模式方面,卷积神经网络已经大大超过了它们的前辈。在改善观察3D物体的无人机和自动驾驶车辆的视觉方面,以及在从心脏、大脑或其他器官的不规则曲面收集的数据中发现模式方面,这些算法也可能会被证明大有用处。

高通和阿姆斯特丹大学的机器学习研究员塔科·科恩是规范等变卷积神经网络的主要设计师之一。

研究人员提出的将深度学习跳脱平面世界的解决方案也与物理学有着深刻的联系。描述世界的物理理论,如爱因斯坦的广义相对论和粒子物理学标准模型,表现出一种被称为“规范等变”的性质。这意味着,世界上物体的数量和它们之间的关系独立于任意的参考系(或“量规”);无论观察者是移动的还是静止的,无论标尺上的数字相距多远,它们都保持一致。在不同的测量仪表上进行的测量必须能够相互转换,以保持物体之间的基本关系。

例如,以码为单位测量一个足球场的长度,然后再以米为单位进行测量。测出来的数字会改变,但这种改变是可预测的。同样地,两个摄影师从两个不同的有利位置拍摄一个物体会产生不同的图像,但那些图像是可以相互关联的。规范等变确保物理学家的现实模型保持一致,不管他们选择什么视角或者测量单位。规范等变卷积神经网络对数据也做了同样的假设。

“他们想要把这种物理学理念应用到神经网络上,” 纽约大学物理学家凯尔·克兰麦(Kyle Cranmer)说,“他们最终也想到了办法。”

跳脱二维世界

伦敦帝国理工学院计算机科学家迈克尔·布朗斯坦(Michael Bronstein)在2015年创造了“几何深度学习”一词,来描述跳脱二维世界,设计能够从非平面数据中学习模式的神经网络的初期努力。这个术语——以及相关研究工作——很快就流行起来了。

布朗斯坦和他的合作者们知道,要超越欧几里得平面,首先需要他们对让神经网络在二维图像识别中如此有效的基本计算过程之一进行重新构想。这个过程称为“卷积”,它让神经网络的一层对小块的输入数据进行数学运算,然后将结果传递到神经网络的下一层。

“粗略地说,你可以把卷积看作滑动窗口。”布朗斯坦解释道。卷积神经网络像过滤器一样在数据上滑动许多这样的“窗口”,每个窗口都被设计用来发现数据中的某种模式。对于猫的照片,受过训练的卷积神经网络会使用过滤器来发现原始输入像素中的低级特征,比如边缘。这些特征信息被传递到网络中的其他层,然后这些层执行额外的卷积并提取更高层次的特征,如眼睛、尾巴或三角形耳朵。接受过识别猫训练的卷积神经网络最终将使用这些分层卷积的结果来为整个图像分配标签,比如“猫”或“不是猫”。

但这种方法只适用于平面。“当你想要分析的表面变得弯曲时,你基本上就有麻烦了。”韦林说。

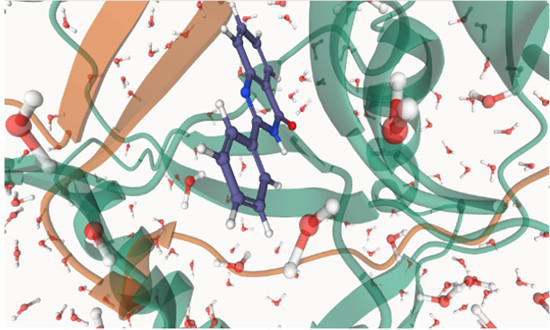

在曲面(几何中称为流形)上进行卷积运算的难度,无异于拿着一小块半透明的图表纸,放在地球仪上,试图精确地描绘出格陵兰岛的海岸线。把图表纸压在格陵兰岛上面时,它肯定会起皱,这意味着当你再次把它放平时,你的绘画就会变形。但是,让图表纸与地球的一点相切,一边盯着纸看,一边追踪格陵兰岛的边缘(一种被称为墨卡托投影的技术),也会产生变形。如果流形不是一个像地球仪一样整齐的球体,而是一个更复杂或不规则的东西,比如一个瓶子的三维形状,或者一个褶曲的蛋白质,在上面进行卷积就更加困难了。

2015年,布罗斯特和他的同事找到了一个在非欧几里得平面上卷积的解决办法:将“滑动窗口”重新构想成某种形状更像圆形蜘蛛网而非图表纸的东西,这样你将其压在地球仪(或者任何其它的曲面)上时就不会产生皱褶、拉伸或撕裂。

以这种方式改变滑动过滤器的属性,使得卷积神经网络更善于“理解”某些几何关系。例如,该网络可以自动识别出一个弯曲成两个不同姿势的3D图形——比如一个站着的人和一个抬起一条腿的人——是同一物体的实例,而不是两个完全不同的物体。这一变化也使得这种神经网络在学习上大大提高了效率。标准的卷积神经网络“使用了数以百万计的形状样本,而且需要数周的训练。”布朗斯坦说,“我们使用了大约100个不同的姿势,训练了大概半个小时。”

与此同时,塔科·科恩和他在阿姆斯特丹的同事们开始从相反的方向来解决同样的问题。2015年,当时还是研究生的科恩并没有在研究如何将深度学习跳脱出平面世界。相反,他感兴趣的是他认为是一个实际的工程问题:数据效率,或者说如何使用更少的样本训练神经网络,而不是像通常需要的那样使用数千甚至数百万的样本。科恩说,“比如说,深度学习方法是非常缓慢的学习者。”如果你在训练卷积神经网络识别猫,这就没有什么问题了(鉴于互联网上有无数的猫的图片)。但是,如果你想让这个网络发现更重要的东西,比如肺组织图像中的癌性结节,那么找到足够的训练数据就不是那么容易了——这些数据需要准确而且恰当的医学标记,并且不存在隐私问题。训练网络所需的样本越少越好。

科恩知道,提高神经网络数据效率的一种方法是,预先对数据进行一定的假设——比如,肺肿瘤仍然是肺肿瘤,不管它在图像中处于旋转状态,还是被反射出来。通常来说,卷积网络必须使用许多相同模式的不同定向的示例进行训练,从头开始学习这些信息。2016年,科恩和韦林合著了一篇论文,定义如何将其中的一些假设作为几何对称编码到神经网络当中。这种方法非常有效,2018年科恩和玛丽西娅·温克尔斯(Marysia Winkels)进一步推广了这种方法,证明了其在CT扫描图中识别肺癌方面有着喜人的效果:他们的神经网络仅使用用于训练其他网络的十分之一的数据,就能识别出这种疾病的视觉证据。

在此基础上,阿姆斯特丹的研究人员继续进行归纳。这就是他们如何实现规范等变的过程。

“等变”思维延伸

物理学和机器学习有一个基本的相似之处。正如科恩所说,“这两个领域都与观察和建立模型来预测未来观察结果有关。”他指出,至关重要的是,这两个领域都不是在寻找单个物体的模型——给予氢原子和颠倒的氢原子不同的描述,并不好——而是在寻找一般范畴的物体的模型。“当然,物理学在这方面是相当成功的。”

等变化(物理学家喜欢用“协方差”)是自爱因斯坦以来的物理学家用来归纳他们的模型的一种假设。“这就意味着,你对一些物理现象的描述,应该与你使用什么样的‘标尺’无关,也与你是什么类型的观察者无关。” 阿姆斯特丹大学理论物理学家米兰达·郑(Miranda Cheng)说。或者正如爱因斯坦本人在1916年所说的那样:“自然的一般规律是由适用于所有坐标系的方程来表达的。”

阿姆斯特丹大学理论物理学家米兰达·郑

通过利用了这一原理的一个简单例子—— “平移等变”——卷积网络成为最成功的深度学习方法之一。发现图像中的某个特征(如垂直边缘)的窗口过滤器会在像素平面上滑动(或“平移”),并对所有的这些垂直边缘的位置进行编码;然后,它会创建一个标记这些位置的“特征图谱”,并将其传递到网络中的下一层。由于平移等变,创建特征图谱是可能的:神经网络“假设”,相同的特征可以出现在二维平面的任何地方,并且能够将垂直边缘识别为垂直边缘,无论它在右上角还是左下角。

“等变神经网络的关键在于,把这些明显的对称性放到网络结构中。”韦勒说。

2018年,韦勒、科恩和他们的博士生导师马克斯·韦林已经将这种理念扩展到了其它的等变种类。他们的“群等变”卷积神经网络可以发现平面图像中的旋转或反射特征,无需就那些定向的特征的具体例子进行训练;球形卷积神经网络可以根据球体表面的数据创建特征图谱,而且不会将其扭曲为平面投影。

这些方法仍然不够通用,无法处理具有凹凸不平、不规则结构的流形方面的数据——这些结构描述了几乎所有物体的几何结构,从土豆到蛋白质,再到人体,再到时空曲率。这些类型的流形不具有“全局”对称性,因此神经网络无法对其进行等变假设:它们上面的每个位置都是不同的。

挑战在于,在平面上滑动平面过滤器可以改变过滤器的方向,具体取决于其选择的特定路径。不妨设想一个被设计来发现简单的模式的过滤器:左侧是一个黑色的斑点,右侧是一个浅色的斑点。在平面上将它向上、向下、向左或向右滑动,它会始终保持右侧朝上。但在球面上,这种情况会发生改变。如果你把过滤器在球体的赤道周围移动180度,过滤器的方向将保持不变:左侧是黑点,右侧是浅色点。然而,如果你让它先穿过球体的北极,再将它滑动到相同的位置,过滤器就颠倒了——右侧是黑点,左侧是浅色点。过滤器不会在数据中发现相同的模式,也不会编码出相同的特征图谱。在一个更复杂的流形上移动过滤器,它可能会指向任意的不一致的方向。

幸运的是,物理学家们已经解决了同样的问题,并找到了一个解决方案:规范等变。

韦林解释说,关键是要忘记跟踪过滤器在不同路径上移动时的方向变化。相反,你可以只选择一个过滤器方向,然后定义一种一致的方式来将所有其他的方向转换成它。

问题是,虽然初始取向时可以使用任意的计量指标,但在将其他的指标转换为那个参照系时,必须要保留基本模式——就像将光速单位从米/秒转化为英里/小时的时候,必须保留基本的物理量。韦林说,通过这种规范等变方法,“实际的数字会改变,但它们的变化是完全可预测的。”

科恩、韦勒和韦林在2019年将规范等变编码到他们的卷积神经网络当中。他们实现这一点的方式是:对神经网络通过卷积在数据中“看到”的东西设置数学约束;只有规范等变模式通过神经网络层传递。“基本上你可以赋予它任何的表面——从欧几里得平面到任意弯曲的物体,包括像克莱因瓶或四维时空这样的奇特流形——不管在什么表面上,都能很好地进行深度学习。”韦林说道。

工作原理

规范等变卷积神经网络的理论是如此的泛化,以至于它自动地整合了以前的几何深度学习方法的内在假设,如球面上的旋转等变。就连布朗斯坦早期的方法——让神经网络识别弯曲成不同姿势的单一3D形状——也适用于它。“规范等变是一个非常广泛的框架。它包含了我们在2015年所做的特殊设置。”布朗斯坦说。

从理论上讲,规范等变卷积神经网络可适用于任何维度的曲面,但科恩和他的合著者已经在全球气候数据上进行了测试。这些数据必然有一个基本的三维球面结构。他们用他们的规范等变框架构建了一个卷积神经网络,该卷积神经网络被训练来从气候模拟数据中发现极端的天气模式,如热带气旋。2017年,政府和学术研究人员使用标准的卷积网络来从数据中发现热带气旋,准确率高达74%;去年,规范等变卷积神经网络以97.9%的准确率发现这种气旋。(它的准确率也超过了2018年专为球体设计的一种不太通用的几何深度学习方法——该系统的准确率达94%。)

劳伦斯伯克利国家实验室使用深度学习技术的气候科学家马约尔·穆迪根达(Mayur Mudigonda)表示,他将继续关注规范等变卷积神经网络。“人类视觉智能的这一方面”——不管模式是什么定向,都能准确识别出来——“是我们想要给气候社区带来的东西。”高通公司最近聘请了科恩和韦林,收购了其旨在整合他们围绕等变神经网络的早期研究的初创公司。高通现在正计划将规范等变卷积神经网络的理论应用于开发更先进的计算机视觉应用,比如使得无人机能够实时进行360度全景“观察”。(这种鱼眼式视觉可以很自然地映射到一个球面上,就像全球气候数据一样。)

与此同时,规范等变卷积神经网络在像克兰默这样的物理学家当中越来越受欢迎,他们计划将其用于亚原子粒子相互作用模拟数据的研究。克兰默说:“我们正在分析与强核力有关的数据,试图了解质子内部的情况。数据是四维的,所以对于有这种规范等变的神经网络,我们有一个再适合不过的用例。”

现在研究规范等变神经网络的前物理学家里西·孔多尔(Risi Kondor)表示,规范等变卷积神经网络的潜在科学应用可能比它们在人工智能中的应用更加重要。

他说,“如果你是在识别YouTube上的猫,却发现自己不太擅长识别上下颠倒的猫,这不是很好,但也许你还能接受。”但对物理学家来说,确保神经网络不会因特定的方向而误认力场或粒子轨迹是至关重要的。“这不仅仅是一个便利性的问题,”孔多尔指出,“重要的是要尊重基本的对称性。”

然而,虽然物理学家的数学有助于启发规范等变卷积神经网络,物理学家可能会发现它们的大量用途,但科恩指出,这些神经网络本身不会发现任何新的物理现象。他说,“我们现在能够设计可以处理非常奇特的数据类型的网络,但你必须得先知道这些数据的结构”。换句话说,物理学家之所以能够使用规范等变卷积神经网络,是因为爱因斯坦已经证明了时空可以表示为四维弯曲流形。科恩的神经网络无法自己“看到”这个结构。他说,“学习对称性是我们不会做的一件事情,”尽管他希望将来能够做到。

科恩不禁为自己曾经凭直觉感知到的跨学科联系感到高兴,现在他已经用数学的严谨性证明了这一点。“我一直有这样一种感觉,即机器学习和物理学正在做非常相似的事情。”他说,“这是我发现的一件非常了不起的事情:我们只是从这个工程问题着手,随着我们开始改进我们的系统,我们逐渐发现了二者之间越来越多的联系。”