5月21日消息,搜狗近日发布了最新一代AI合成主播——全球首个手语AI合成主播“小聪”,从技术上给听障人士获取信息、更好融入社会提供了一种新帮助。

根据世界卫生组织发布的最新数据显示,全球有约4.66亿人有听力障碍,在我国听障人员有2700万人。由于受教育程度参差不齐,除了文字,手语仍是听障人士的第一语言。

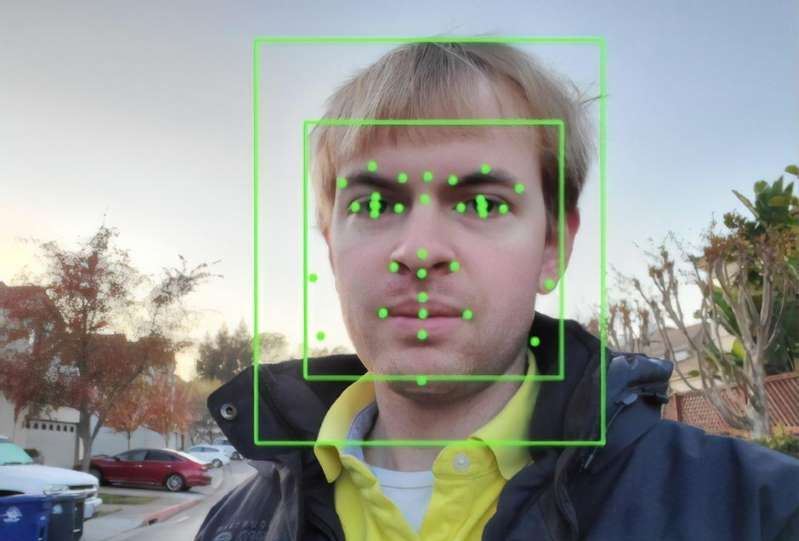

手语AI合成主播“小聪”是基于搜狗人工智能和AI分身技术打造的“数字人”,以打造聋人真正可懂的通用手语播报为目标。“小聪”集成了3D数字人建模、机器翻译、多模态数字人生成、迁移学习、实时面部动作生成及驱动等多项AI技术。在组织的聋人可懂度测评中,“小聪”的手语播报可懂度可以达到85%以上。

手语AI主播创意源于一次网友交流

谈及搜狗打造全球首个手语AI合成主播的初衷,搜狗AI交互技术部总经理陈伟回忆道,2019年的时候看到微博上有一位聋人朋友吐槽自己的搜狗语音没法正常用,无法和朋友交流。在通过私信沟通帮他解决问题后,我们意识到其实听障群体对信息获取这件事情特别有期待。如何更好的用搜狗的技术帮助听障人群获取信息,此后我们开始思考并行动。

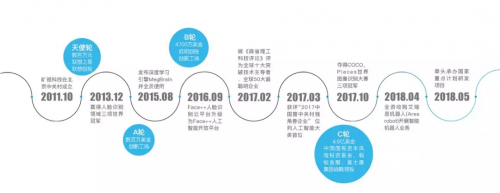

事实上,搜狗在AI合成主播领域已深耕多年。从2018年首次推出AI合成主播到现在,搜狗“数字人”技术已经进行了多次迭代进化。

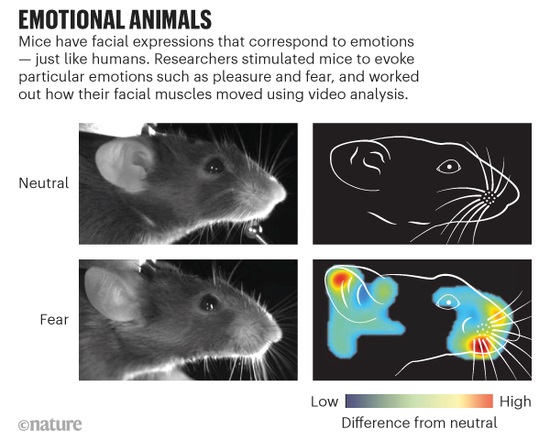

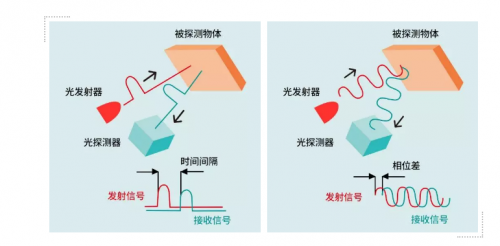

但是,和有声语言不同,手语是一种视觉空间语言,以表形表意为主,是通过手势、表情、唇动、姿态等方式来表达的。这也意味着手语拥有自身独特的表达逻辑和特点,比如手语表形度高、词性结构不发达、语序语法结构独立等等。

详细来说,手语的语序,跟汉语语序表达不一样的地方;在词汇方面,手语里没有虚词,没有量词;手语里特有的非手控的信息,比如说表情、口动、身体的朝向这部分在语音语言里是没有的。

相比较搜狗此前推出的数字人语音主播,手语主播“小聪”背后又有哪些技术思考和突破呢?

手语AI主播的“超”能力

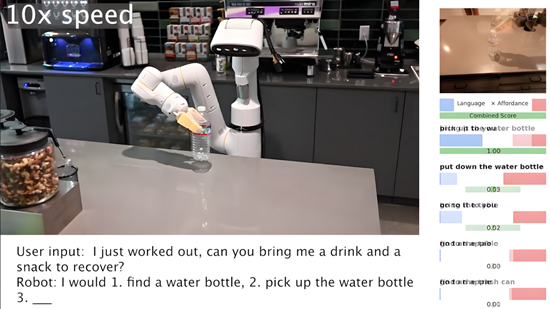

“如何把手语语言体系进行计算机应用转化,这件事此前业内并没有特别明确的做法。”,陈伟分析认为,要做出真正让聋人可懂的手语“数字人”,需要解决三个问题:一是,完成手语语言向计算机语言转化。二是,实现健听人和聋人两种语言之间高效高质量转换。三是,驱动“数字人”做出逼真的自然连贯的手语动作和面部表情。

在明确了要解决的问题后,搜狗技术产品团队开始有针对性的逐一突破。

陈伟称,要解决上面三个问题,第一需要把手语词汇转化成文字或技术方式标注出来;第二需要构建健听人语序和聋人之间语序之间的平行语料对,这需要大量的机器翻译库;第三需要通过捕捉的方式,预先捕捉大量的真人动作和表情数据,这些数据用来做模型训练。

另外,陈伟强调,此前搜狗做3D AI合成主播时一直强调唇形,最多加上表情。手语AI合成主播还需要加入更多新的维度,比如主播的嘴形、表情、姿态、手部动作一定要保证在同一时间完成。如果嘴形或动作有提前或滞后情况,这样给人的感觉就是表达不够准确。所以技术上要做到充分对齐,通过多模态端到端生成模型进行联合建模及预测,生成高准确率的动作、表情、唇动等序列。

针对手语AI主播项目,搜狗除了内部组建了语言、产品和研发体系外,还专门设置了一个“顾问团”。

据说,顾问团由三类型人员组成,一部分是国家官方聋协和残联标准部门专家;一部分是手语学校的老师,能够听懂声音,同时也能打好手语,做手语教学的人;第三部分是手语的使用者,也就是聋人。通过把手语语言专家、工程师、研究员、实际用户集中在一起,持续沟通、产品迭代,最终打造出全球首个手语AI合成主播“小聪”。

现在,在数字人效果方面,“小聪”使用了3D重光照扫描还原、面部肌肉驱动、表情肢体手势捕捉技术,生产出了高度还原真人发肤、形象逼真、动作自然生动的数字人模型,手语播报的真实感与亲切感大幅提升。

手语表达方面,“小聪”能够实现健听人语言与听障者手语语言的机器翻译能力,基于输入的健听人语言能够低延迟生成高准确率的手语语言表征,快速生成数字人手语播报视频,达成信息有效传递。

手语展现方面,“小聪”可以完整实现手控信息及非手控信息的表达,手语表征信息,覆盖手部动作、面部表情、口动唇动等多个维度,达到自然、地道、接受度更高的手语表达效果。

自2018年发布全球首个AI合成主播至今,搜狗的“数字人”已经广泛应用于广电、媒体、金融、证券、保险、司法、教育、气象等诸多领域。陈伟透露,搜狗手语AI合成主播预计今年年底将实现大规模应用。